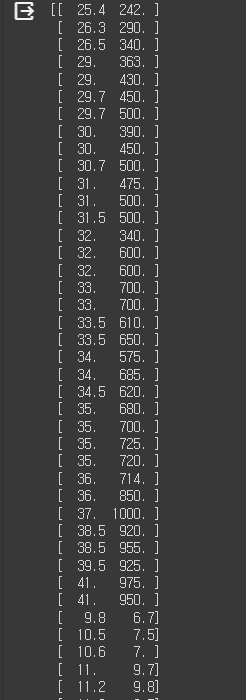

훈련 세트와 테스트 세트import numpy as np input_arr = np.array(fish_data) target_arr = np.array(fish_target) print(input_arr)

'샘플링 편향'

훈련 세트와 테스트 세트에 샘플이 골고루 섞여 있어야 한다.

-> 하나도 훈련시키지 않은 데이터를 나중에 테스트 세트에 포함시켜 버리면 제대로 학습이 되지 않았음을 확인할 수 있음

numpy : 고차원의 배열을 다루고 편집하기 편하다.

라이브러리를 추가해 주어야 함

fish_length = [25.4, 26.3, 26.5, 29.0, 29.0, 29.7, 29.7, 30.0, 30.0, 30.7, 31.0, 31.0,

31.5, 32.0, 32.0, 32.0, 33.0, 33.0, 33.5, 33.5, 34.0, 34.0, 34.5, 35.0,

35.0, 35.0, 35.0, 36.0, 36.0, 37.0, 38.5, 38.5, 39.5, 41.0, 41.0, 9.8,

10.5, 10.6, 11.0, 11.2, 11.3, 11.8, 11.8, 12.0, 12.2, 12.4, 13.0, 14.3, 15.0]

fish_weight = [242.0, 290.0, 340.0, 363.0, 430.0, 450.0, 500.0, 390.0, 450.0, 500.0, 475.0, 500.0,

500.0, 340.0, 600.0, 600.0, 700.0, 700.0, 610.0, 650.0, 575.0, 685.0, 620.0, 680.0,

700.0, 725.0, 720.0, 714.0, 850.0, 1000.0, 920.0, 955.0, 925.0, 975.0, 950.0, 6.7,

7.5, 7.0, 9.7, 9.8, 8.7, 10.0, 9.9, 9.8, 12.2, 13.4, 12.2, 19.7, 19.9]

fish_data = [[l,w] for l,w in zip(fish_length,fish_weight)]

fish_target = [1]*35 + [0]*34

from sklearn.neighbors import KNeighborsClassifier

kn = KNeighborsClassifier()

print(fish_data) # 아래 numpy출력보다 불친절함.. numpy를 사용하는 이유

import numpy as np

input_arr = np.array(fish_data)

target_arr = np.array(fish_target)

print(input_arr)

.shape로 행렬 크기를 알 수도 있다.

2-1은 1-3에서 진행했던 K-NN최근접 이웃 알고리즘을 사용하여 랜덤으로 49개의 test케이스 중 35개를 훈련에 사용하고 14개를 테스트에 사용하여 평가하였다. -> 1-3에서 이미 훈련에 사용된 데이터를 통해 성능을 평가하면 당연히 평가가 잘 나올 수 밖에 없기 때문이다.

#훈련 데이터

train_input = input_arr[index[:35]]

train_target = target_arr[index[:35]]

#print(train_input)

#테스트 데이터

test_input = input_arr[index[35:]]

test_target = target_arr[index[35:]]

import matplotlib.pyplot as plt

plt.scatter(train_input[:,0], train_input[:,1])

plt.scatter(test_input[:,0], test_input[:,1])

"""

[:,0]: 이는 모든 행(:)에서 첫 번째 열(0)을 선택하는 것을 나타냅니다.

[:,1]: 이는 모든 행(:)에서 두 번째 열(1)을 선택하는 것을 나타냅니다.

"""

plt.xlabel('length')

plt.ylabel('weight')

plt.show()

kn.fit(train_input,train_target)

kn.score(test_input,test_target)

kn.predict(test_input)

#출력값은 넘파이 배열임. 모든 사이킷런 입출력 배열은 넘파이

test_target #predict와 비교해보면 모두 맞춘 것을 확인할 수 있다.

'ML' 카테고리의 다른 글

| ML4 확률적 경사 하강법8 (0) | 2024.08.07 |

|---|---|

| ML3 / 다중회귀, 특성공학 (0) | 2024.07.28 |

| ML 1-3 (2) | 2024.01.28 |